di Lorenzo Lazzeri

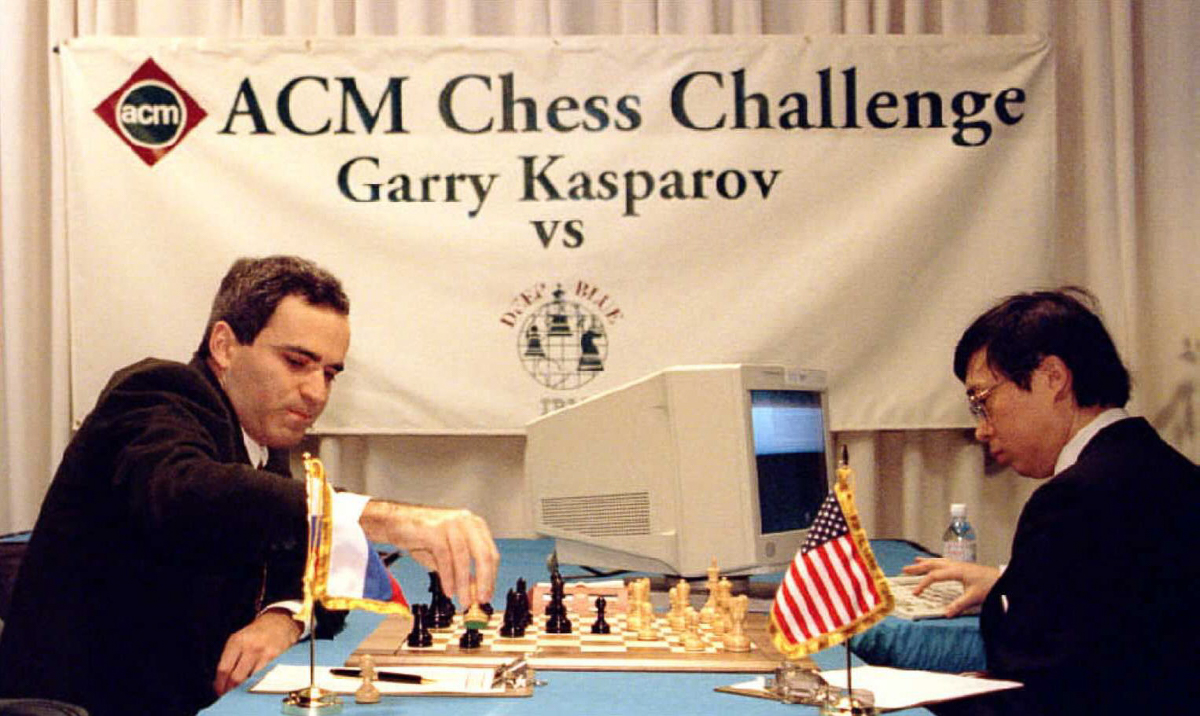

La selezione quotidiana degli obiettivi da bombardare a Gaza, dall’ottobre 2023, è passata anche attraverso tre sistemi di intelligenza artificiale operativi all’interno delle Forze di Difesa Israeliane (IDF). Si chiamano Habsora, Lavender e Where is Daddy. Nessuno dei tre è rimasto allo stadio sperimentale e tutti hanno operato sul campo, comandando i sistemi di puntamento e stabilendo le coordinate da bombardare.

Con Habsora, in ebraico “il Vangelo“, l’IDF ha automatizzato la selezione di edifici e infrastrutture da colpire sulla base di presunti legami con Hamas. I numeri rendono l’idea della scala: prima di Habsora circa 50 obiettivi l’anno; con il sistema fino a 100 al giorno. La cadenza di produzione di nuovi obiettivi ha imposto un ritmo di bombardamento mai raggiunto nelle precedenti operazioni a Gaza.

Lavender identificava persone. È un database alimentato dall’intelligenza artificiale che ha catalogato fino a 37.000 uomini palestinesi come sospetti militanti di Hamas o della Jihad Islamica. L’identificazione avviene attraverso l’analisi di metadati delle comunicazioni: orari e durata delle chiamate, posizioni rilevate dai telefoni, reti di contatto. A ogni individuo Lavender assegna un punteggio di rischio, calcolato anche sull’appartenenza a gruppi WhatsApp specifici e sulla frequenza di sostituzione del telefono. L’accuratezza dichiarata sul campione era del 90%. Il restante 10% rappresentava individui con legami deboli o inesistenti con organizzazioni armate. L’esercito ha accettato questo margine prima di autorizzare l’uso semi-automatico delle liste. Le cifre provengono dall’inchiesta di +972 Magazine e Local Call, pubblicata nell’aprile 2024 e basata sulle testimonianze di sei ufficiali dell’intelligence israeliana.

Dalle fonti la revisione umana è stata descritta come un atto formale. Durava circa venti secondi per nome e si limitava a verificare che il segnalato fosse di sesso maschile: nessun esame del contesto operativo, nessuna verifica sulla presenza di civili nell’area.

Il terzo anello della catena era “Where is Daddy?“, che tracciava i nomi suggeriti da Lavender e indicava quando rientravano nell’abitazione. La logica operativa prevedeva di colpire i bersagli in casa, spesso assieme alle famiglie. Le soglie di vittime civili erano pre-approvate: fino a 15-20 per un operativo di basso livello, oltre 100 per un comandante di rango superiore.

Per i bersagli secondari le forze israeliane hanno impiegato bombe non guidate, incapaci di correzione in volo e con un raggio d’impatto ampio. La scelta rispondeva al criterio di non impiegare munizioni guidate, troppo costose per obiettivi minori. Alla ponderazione degli algoritmi corrispondeva un’esecuzione deliberatamente imprecisa.

L’esistenza dei tre sistemi, utilizzati quantomeno fino all’attuale tregua solo formale, non è mai stata smentita. La posizione ufficiale dell’IDF è che l’intelligenza artificiale opera come strumento di “supporto” e che ogni attacco rispetta il diritto internazionale umanitario. La fonte principale è l’inchiesta di Yuval Abraham per +972 Magazine e Local Call, costruita su testimonianze dirette di ufficiali dell’intelligence e ripresa dal Guardian e da altre testate internazionali.

Quando la macchina indica gli obiettivi e la supervisione è minima il margine di errore è alto, ma accettato in anticipo. Resta una domanda a cui nessun algoritmo può rispondere: chi è responsabile quando la decisione di uccidere è presa prima che chiunque apra un fascicolo?

Quello qui pubblicato è uno dei quattro articoli dell’inchiesta.